从功能机到实时智能体:CES2026揭示硬件进化,声网RTC如何完成关键一跃?

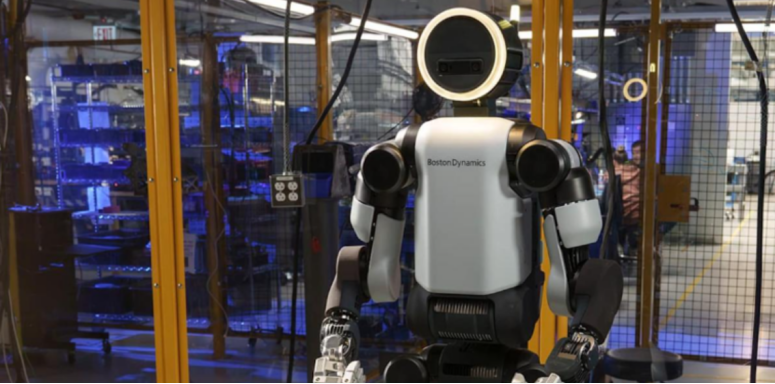

在CES2026的展台上,我们看到了一幅清晰的图景:硬件正在经历一场深刻的“身份变革”。无论是智能机器人、无人机,还是智能座舱,都从过去的“功能机”模式,进化为能够感知、交互、协同的“实时智能体”。这一转变背后的关键技术支撑,正是实时音视频(RTC)技术。而来自中国的声网,以其全球领先的实时互动能力,正在帮助全球硬件制造商完成这一关键跃迁。

一,功能机的局限:单机时代的技术天花板

传统硬件产品本质上是“功能机”——设备在本地执行预设功能,缺乏实时感知与协同能力。这种架构面临三大局限:

1. 交互能力单一:基于本地语音识别或简单传感器,无法实现复杂场景下的自然交互

2. 计算能力受限:端侧算力难以支撑高质量音视频处理与AI分析

3. 数据孤岛化:设备间缺乏实时数据共享与协同能力

这些局限在智能机器人、智能汽车等新兴领域尤为明显,成为硬件智能化的主要瓶颈。

二,实时智能体的三大技术特征

实时智能体的核心特征是通过云端协同实现能力的跃升。这种架构需要三方面的技术支撑:

1.超低延迟的实时感知系统

智能体需要像人类一样“即听即应”。声网通过全球软件定义实时网SD-RTN™实现端到端延迟中位数<76ms,其中对话式AI的打断响应延迟可低至340ms。这一指标已接近人类自然对话的响应节奏(约200-300ms),为实现拟人化交互奠定基础。

2.智能环境感知与适应能力

真实世界环境复杂多变,智能体必须能在各种条件下保持稳定性能。声网在这方面实现了多重技术突破:

•极致弱网对抗:80%丢包率下仍保持音视频流畅,即使断网3-5秒也能自动恢复 •智能音频处理:风鸣音频引擎支持48kHz全频带采样,配合AI降噪可抑制100+种突发噪声 • 自适应视频编码:自研编码算法在同等画质下可降低70%码率,支持4K超高清传输

3.多模态协同与决策能力

单一感知通道已不能满足复杂场景需求。声网支持:

• 多路高清视频并行上行(满足机器人、无人机全景监控需求) • 音视频与数据流的同步传输 • 云端AI能力的实时调用与响应

三,实际应用场景中的技术实现

• 智能车机场景 传统车载系统仅提供本地娱乐与导航功能。通过集成声网RTC能力,可实现:低延迟对话式AI(响应时间<650ms)、千里眼远程查看(多路高清视频上行) • 无人机/无人车巡检 从简单的遥控操作升级为智能协同作业:能实现多机协同视频采集与拼接 • 服务机器人 从程序化响应到情境化交互:能够实现多模态意图识别(语音+视觉+传感器融合)、远程人工接管与辅助、紧急情况下的即时视频呼叫

四,技术挑战与创新解决方案

在实现实时智能体的过程中,声网攻克了多项技术难题:

• 移动场景下的网络适应:预测性网络质量评估与自适应码率调整 • 资源受限设备的优化:针对嵌入式设备的CPU、内存限制,开发轻量级SDK: • 安全与隐私保护:端到端加密传输结合硬件级安全模块,确保音视频数据的安全性和用户隐私。

免责声明:本内容为广告,相关素材由广告主提供,广告主对本广告内容的真实性负责。本网发布目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责,广告内容仅供读者参考,如有疑问请联系:0564-3996046。